Сервер хранения данных на базе NVIDIA Grace Superchip от Supermicro

Посчитайте счёт за электричество в вашем дата-центре за прошлый год. А теперь вычтите из него расходы на СХД. Не на диски — на серверную часть, которая эти диски обслуживает. У большинства компаний цифра получается неприятная, потому что двухсокетный x86-сервер с Xeon Platinum под хранилище потребляет 700–900 Вт только в простое, и никто особо не задумывается, зачем он там нужен с таким аппетитом.

Supermicro ARS-121L-NE316R предлагает другой путь. Внутри — NVIDIA Grace Superchip: 144 ядра Arm Neoverse V2 при TDP 500 Вт. Это не урезанная версия и не мобильный чип в серверном корпусе. Это вычислительная платформа, которую Supermicro переосмыслила под задачи высокопроизводительного хранения — и сделала это не самым очевидным способом.

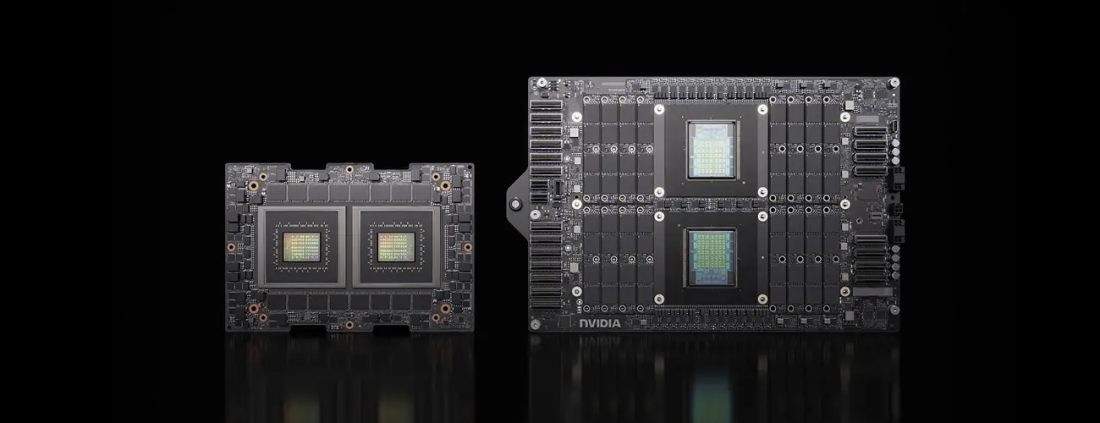

Что такое Grace Superchip и зачем он здесь

Grace Superchip — это два процессора Grace, соединённых через NVLink-C2C с пропускной способностью 900 ГБ/с. Не PCIe, не Infinity Fabric, не UPI — своя высокоскоростная шина. Результат: единый NUMA-узел с 144 ядрами, который операционная система видит как одну связную систему без штрафов за межпроцессорные обращения.

Почему это принципиально для хранения? В двухсокетном x86-сервере каждый раз, когда данные, обрабатываемые на одном сокете, нужны процессу на другом, происходит обращение через UPI или Infinity Fabric. Задержка — 80–100 нс дополнительно к и без того не нулевой латентности NVMe. На IOPS-нагрузке с короткими транзакциями это копится и становится видимым в перцентилях p99/p999. Единый NUMA-домен Grace этот класс проблем убирает структурно, а не патчами на уровне numactl.

Память — LPDDR5X, до 960 ГБ с суммарной пропускной способностью до 1 ТБ/с. Для сравнения: DDR5-6400 в четырёхканальной конфигурации даёт около 200–250 ГБ/с на сокет. У Grace — в два раза больше на всю систему при вдвое меньшем энергопотреблении памятной подсистемы.

Проблема в том, что Grace изначально проектировался под HPC и AI-нагрузки, а не под хранение. PCIe-линии у него есть, но их распределение не рассчитано на 16 NVMe-дисков напрямую. Supermicro решила это через PCIe-коммутатор и кабели MCIO — архитектурно это добавляет один hop, но позволяет подключить все 16 NVMe Gen5 без деградации пропускной способности. Решение нестандартное, но работающее.

Питание — два блока по 1,6 кВт с сертификатом 80Plus Titanium (КПД >96% при нагрузке 50%). Это означает, что из розетки потребляется примерно 520–525 Вт при полной загрузке системы. Реально, если NVMe-диски не в активном состоянии одновременно (а при типовом SDS-сценарии они не бывают), реальное потребление будет 350–400 Вт. Два резервированных БП — стандарт для production, здесь без сюрпризов.

Где это работает и почему

1U-форм-фактор, 16 NVMe PCIe Gen5 SSD, 960 ГБ оперативной памяти и 144 ядра — это не универсальный сервер хранения. Это специализированная машина для Software-Defined Storage с высоким процентом вычислений на пути данных. Если ваш стек хранения не делает ничего с данными кроме чтения/записи — берите обычный JBOD и не переплачивайте (но убедитесь, что не совершаете типичные ошибки при выборе СХД). Но если на пути каждого блока стоит шифрование, сжатие, дедупликация или контрольные суммы — вот тут начинается разговор.

Ceph. Операции шифрования (BlueStore шифрует OSD-данные) и дедупликации требуют процессорного времени на каждой транзакции. На x86 под нагрузкой это превращается в CPU-буттлнек при высоком IOPS. 144 ядра Arm Neoverse V2 с поддержкой криптографических инструкций (AES-NI аналоги в Armv9) справляются с этой нагрузкой при сопоставимом TDP. Тесты Ceph на Arm-платформах показывают, что при включённом шифровании деградация IOPS составляет 5–8% против 15–20% на сопоставимом x86 — именно за счёт аппаратного ускорения крипто в Armv9-ядрах.

MinIO / объектное хранение. MinIO активно использует многопоточность для параллельной обработки запросов. 144 лёгких ядра здесь эффективнее, чем 64 тяжёлых x86-ядра при той же мощности. Плюс 960 ГБ LPDDR5X — это горячий кэш, который практически не имеет аналогов в сопоставимом TDP-диапазоне.

VAST Data и аналогичные платформы. Архитектура VAST предполагает хранение горячих данных в NVMe-tier и активную работу с метаданными в памяти. 1 ТБ/с пропускной способности памяти здесь не избыточность, а рабочая характеристика.

Сравнение с x86-аналогами

Честное сравнение требует понимания ниши. Grace не пытается заменить 2U-сервер с 24 NVMe и двумя Xeon — у того больше слотов и выше абсолютный IOPS за счёт количества дисков. Впрочем, и внутри x86-лагеря выбор неочевиден — подробнее об этом в материале «сравнение Intel и AMD для бизнес-задач». Grace выигрывает там, где важна пропускная способность памяти, вычислительная плотность и энергоэффективность. Сравнивать их как «одинаковые устройства» — всё равно что сравнивать спринтера и марафонца по весу.

Вот числа для принятия решения:

| Характеристика | Supermicro ARS-121L-NE316R (Grace) | Supermicro X13 (2× Xeon Platinum) | HPE ProLiant DL380 Gen11 (2× EPYC) |

|---|---|---|---|

| Ядра / архитектура | 144 × Arm Neoverse V2 | 64–128 × x86 | 96–192 × x86 |

| Память (макс.) | 960 ГБ LPDDR5X | 4 ТБ DDR5 | 3 ТБ DDR5 |

| Пропускная способность памяти | ~1 ТБ/с | ~300–400 ГБ/с | ~400 ГБ/с |

| Слотов NVMe | 16 (PCIe Gen5) | 24+ (PCIe Gen5) | 20+ (PCIe Gen5) |

| TDP системы | ~500 Вт | 700–1000 Вт | 800–1100 Вт |

| Форм-фактор | 1U | 2U | 2U |

Что видно из таблицы: по объёму памяти x86 выигрывает (DDR5 DIMM позволяет набрать 4 ТБ), по количеству дисков — тоже. Но Grace в 1U при 500 Вт даёт пропускную способность памяти, недостижимую на x86 без перехода на HBM. Для SDS-нагрузок, где данные активно перемещаются между памятью и NVMe-tier, это принципиально.

Ещё один угол: лицензирование. Ряд enterprise-решений для хранения (VMware vSAN, некоторые версии NetApp ONTAP Select) лицензируется per-socket или per-core. Переход с двухсокетного x86 на однопроцессорный Grace Superchip (один «сокет» в терминах лицензирования) может дать неожиданную экономию на лицензиях — проверьте условия вашего вендора перед закупкой.

Деплой: что надо знать перед установкой

Arm в production-окружении — это не 2010 год с экзотическими патчами и двумя сопровождающими. Ubuntu 22.04/24.04, Debian 12, RHEL 9 — все поддерживают Arm64 без оговорок. Пакетные репозитории полные, docker-образы для типовых SDS-стеков доступны для arm64 без пересборки.

Proxmox VE работает на Arm начиная с версии 8.x через community-сборки, но официальная поддержка пока не объявлена — учтите это при выборе гипервизора для production. Если нужен полноценный vendor support, смотрите в сторону RHEL 9 с KVM или VMware на случай, когда появится Arm-релиз. Kubernetes на Arm64 — полностью поддерживаемый сценарий: k8s, Rancher, OpenShift — всё работает.

Ceph устанавливается стандартно через cephadm:

curl --silent --remote-name --location https://download.ceph.com/rpm-2024.2/el9/noarch/cephadm

chmod +x cephadm && ./cephadm bootstrap --mon-ip

Arm64-пакеты Ceph доступны в официальных репозиториях начиная с Quincy (17.x). Никаких дополнительных флагов компиляции — бинарники собраны с поддержкой криптографических инструкций Armv9 из коробки.

Управление — через OOB-интерфейс на задней панели (IPMI/Redfish), аналогично любому серверу Supermicro. Zabbix мониторит через IPMI или SNMP без дополнительных агентов. Если уже есть шаблоны для Supermicro X12/X13, они подойдут с минимальными правками.

Что стоит проверить при миграции с x86: библиотеки с hardcoded x86-инструкциями (SSE4, AVX). В SDS-стеках их немного, но проверка через file /path/to/binary и ldd сэкономит нервы при первом запуске.

Отдельная история — мониторинг температуры и питания. Grace Superchip при TDP 500 Вт в 1U-корпусе требует хорошего воздушного потока через стойку. Supermicro рекомендует минимум 8 слотов свободного пространства над и под сервером при фронтальном охлаждении. При плотной компоновке стойки — считайте тепловой бюджет заранее, не после первого теплового троттлинга. IPMI выдаёт все необходимые метрики через Redfish, так что интеграция в существующий мониторинг — вопрос одного вечера.

Ещё момент по сети: на задней панели — слоты AIOM и OCP NIC 3.0 (PCIe Gen5 x16). Это значит, что 100GbE или 200GbE NIC ставится без дополнительных адаптеров, напрямую в материнскую плату. Для Ceph-кластера, где сеть между OSD-нодами — узкое место, это не мелочь.

Безопасность: Arm приносит кое-что сверху

Armv9-архитектура включает Memory Tagging Extension (MTE) — аппаратный механизм тегирования памяти, который позволяет обнаруживать use-after-free и buffer overflow на уровне железа, не только в runtime-санитайзерах. Для SDS-стека, где ошибки в памяти могут привести к повреждению данных клиентов, это дополнительный слой защиты без заметного влияния на производительность.

Pointer Authentication (PAC) и Branch Target Identification (BTI) — защита от атак типа ROP/JOP прямо в железе. На x86 эквивалент (Intel CET) появился в Ice Lake, но реализован иначе. Armv9 делает это более последовательно и с меньшими оговорками по поддержке в компиляторах.

Это не означает, что Grace Superchip — серебряная пуля по безопасности. Но для организаций, строящих хранилище персональных данных под GDPR или ФЗ-152, аппаратные механизмы защиты памяти — аргумент, который стоит занести в техническое задание.

Куда это движется

NVIDIA уже анонсировала Grace Blackwell Superchip — следующее поколение с GPU-компонентом Blackwell на борту. Для задач AI-Storage (инференс прямо на ноде хранения, векторные базы данных) это меняет архитектуру принципиально: вычисления переезжают туда, где живут данные, а не наоборот. Тем, кто уже сейчас строит инфраструктуру под ИИ, стоит изучить подбор серверов для задач искусственного интеллекта. Это не абстрактная перспектива — уже сейчас pgvector и Milvus активно используются поверх NVMe-кластеров, и задержка передачи данных между storage-нодой и GPU-нодой — реальная операционная проблема.

Жидкостное охлаждение для Grace — не экзотика, а логичное следствие плотности. 500 Вт в 1U при воздушном охлаждении работает, но при сборке плотных кластеров (10+ нод в одной стойке) тепловой бюджет быстро становится критическим. Supermicro предлагает варианты с Direct Liquid Cooling — трубки к чипу, тепло уходит в контур, а не в воздух. В европейских дата-центрах с тарифами на cooling это окупается за 18–24 месяца.

ROI считается через OPEX. Если x86-альтернатива потребляет на 400–500 Вт больше при сопоставимой производительности в SDS-сценарии, за три года при тарифе 100 р/кВт·ч экономия составит порядка 1 000 000–1 300 000 на ноду. В кластере из 10 нод — цифра уже разговорная на уровне директора. При российских тарифах на электроэнергию для бизнеса (в среднем 5–7 руб./кВт·ч по данным 2024 года) срок окупаемости разницы в цене оборудования сжимается до 2–3 лет.

Рынок Arm-серверов в enterprise-сегменте созревает. Ecosystem вокруг Arm64 в Linux уже не экспериментальный — это production-ready платформа с полным стеком поддержки. ARS-121L-NE316R — одна из первых точек входа для тех, кто хочет попробовать архитектуру на реальной нагрузке и получить данные для следующего цикла закупок, а не читать маркетинговые слайды производителя.

Если вы давно думаете о миграции части инфраструктуры хранения с x86 и хотите оценить реальные характеристики Arm в production, этот сервер — честный вариант для пилота. Не потому что он идеален, а потому что у него есть конкретная ниша, понятные компромиссы и достаточная экосистемная зрелость для работы без изобретения велосипеда. Пилот на одной ноде покажет больше, чем любые бенчмарки вендора — и даст понимание, стоит ли масштабировать.