Охлаждение серверной: расчет TDP, схемы воздушных потоков и кондиционирование

- Расчёт TDP: сколько тепла реально выделяет Ваша серверная

- Требования к серверной комнате по температуре и влажности

- Горячий и холодный коридор: разделяй и властвуй

- Расчёт кондиционера для серверной: формула и нюансы

- Воздушные потоки: front-to-back и что бывает, когда всё не так

- Энергоэффективность и PUE: цифры, которые видит бухгалтерия

- Что дальше: жидкостное охлаждение и утилизация тепла

Серверная комната мощностью 50 кВт выделяет тепла столько же, сколько 50 бытовых электрообогревателей, работающих на полную. Разница в том, что обогреватели можно выключить, а серверы — нет. И если тепло не уходит, оно убивает оборудование. Молча, без предупреждений, через деградацию компонентов и внезапные отказы дисков. Охлаждение ЦОД — это та часть инфраструктуры, на которой нельзя «оптимизировать бюджет». Потому что цена ошибки — не счёт за электричество, а потерянные данные и простой бизнеса.

Давайте разберёмся, как считать тепловыделение, строить воздушные потоки и подбирать кондиционирование так, чтобы серверная работала надёжно, а не превращалась в сауну с дорогим железом.

Расчёт TDP: сколько тепла реально выделяет Ваша серверная

TDP (Thermal Design Power) каждого компонента указан в спецификациях, но итоговое тепловыделение серверной — это не просто сумма TDP процессоров. Считать нужно всё: CPU, GPU, память, диски, сетевое оборудование, ИБП. Причём паспортный TDP процессора — это тепловой пакет под расчётной нагрузкой, а реальное потребление при турбо-бусте или под AI-нагрузками может превышать номинал на 20–40%.

Формула расчёта полного тепловыделения выглядит так:

Q_total = (Σ P_IT) × 1.2–1.3

Где Σ P_IT — суммарная потребляемая мощность IT-оборудования, а коэффициент 1.2–1.3 — запас на пиковые нагрузки, потери в ИБП и рост парка. Этот запас — не перестраховка, а инженерная норма. ASHRAE TC 9.9 рекомендует закладывать резерв на расширение и учитывать, что реальное потребление серверов под нагрузкой отличается от idle-режима в 2–3 раза.

Вот как это работает для типичной серверной:

| Оборудование | Кол-во | Мощность (Вт) | Суммарно (кВт) |

|---|---|---|---|

| 2U серверы (2× Xeon, 512 GB RAM) | 20 | 750 | 15.0 |

| GPU-серверы (4× A100) | 4 | 2500 | 10.0 |

| СХД (дисковые полки) | 3 | 1200 | 3.6 |

| Сетевые коммутаторы | 6 | 350 | 2.1 |

| ИБП (потери) | 2 | 800 | 1.6 |

| Итого |

|

|

32.3 |

| С запасом ×1.25 |

|

|

~40 кВт |

Эти 40 кВт — тепловая нагрузка, которую системе охлаждения нужно отводить. Каждый ватт потреблённой мощности превращается в ватт тепла. Физику не обманешь.

Требования к серверной комнате по температуре и влажности

ASHRAE TC 9.9 задаёт два диапазона для серверных помещений класса A1 (а это подавляющая часть корпоративных серверных):

| Параметр | Рекомендуемый | Допустимый |

|---|---|---|

| Температура на входе в сервер | 18–27°C | 15–32°C |

| Относительная влажность | 40–60% | 8–80% |

| Точка росы | — | макс. 17°C |

| Скорость изменения | — | ≤20°C/ч (SSD), ≤5°C/ч (HDD) |

Рекомендуемый диапазон — это зона, в которой оборудование работает с расчётным сроком службы. Допустимый — зона, где сервер не выключится аварийно, но деградация компонентов ускоряется. Разница между 25°C и 35°C на входе в сервер — это не «ну, потеплее немного». Это удвоение скорости старения конденсаторов и рост частоты отказов дисков.

Полные требования к серверной комнате включают не только температуру. Влажность ниже 20% — риск электростатических разрядов. Выше 80% — конденсат на платах. Между этими крайностями — штатная работа, но оптимум для долговечности оборудования лежит в узком коридоре 40–60%.

Горячий и холодный коридор: разделяй и властвуй

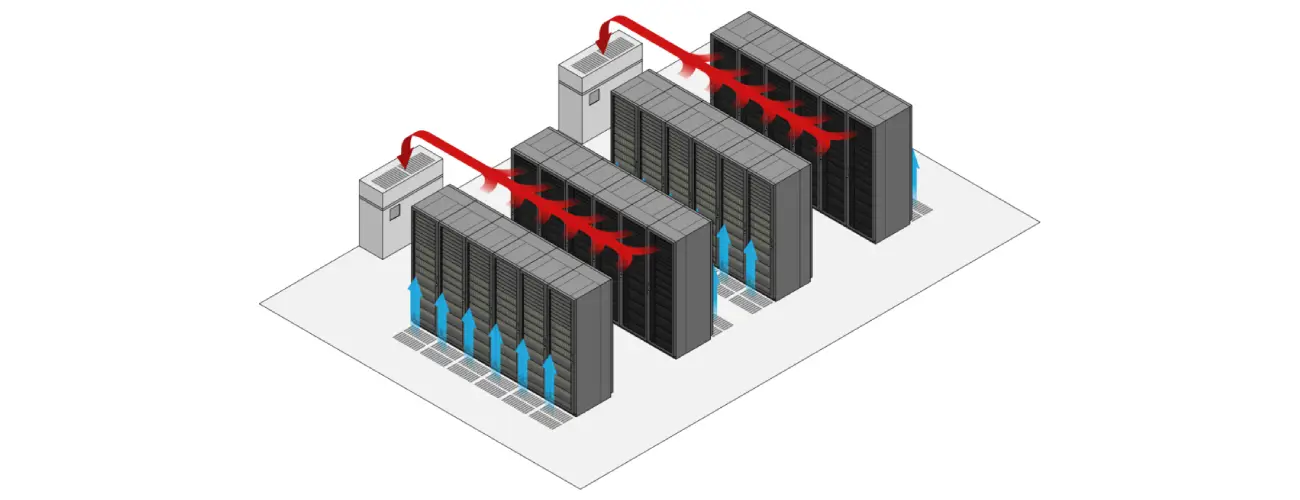

Идея проста: серверы втягивают воздух спереди и выбрасывают горячий сзади. Если поставить стойки лицом друг к другу — между ними образуется холодный коридор (cold aisle), куда подаётся охлаждённый воздух. Задние стороны стоек тоже смотрят друг на друга, формируя горячий коридор (hot aisle), откуда нагретый воздух возвращается к кондиционерам.

Без этого разделения горячий воздух из задней части стоек перемешивается с холодным, температура на входе в серверы растёт неравномерно, и появляются «горячие точки» — локальные зоны перегрева. Кондиционер работает на пределе, а верхние юниты в стойках всё равно перегреваются.

Организация горячих и холодных коридоров с физическим разделением (containment) — шторками, панелями, дверями — повышает эффективность охлаждения на 30% и выше. По данным Schneider Electric, горячий коридор с containment экономит до 43% затрат на охлаждение относительно холодного коридора, что соответствует снижению PUE на ~15%. Причина — горячий воздух возвращается к кондиционерам с высоким перепадом температур (до 45–47°C), и теплообменник работает эффективнее.

Типичные ошибки при организации коридоров:

- Пустые юниты в стойках без заглушек. Горячий воздух «переливается» через незакрытые отсеки обратно в холодный коридор, сводя на нет весь смысл разделения. Заглушки (blanking panels) стоят копейки, а эффект дают колоссальный.

- Кабельные проходы без уплотнения. Щели в фальшполу вокруг кабельных трасс — это утечки холодного воздуха. Резиновые уплотнители и щётки-кабелепроходы решают проблему.

- Неправильная раскладка перфорированных плиток. Перфорированные плитки фальшпола должны стоять только в холодных коридорах. Плитка перед «лицом» стойки — хорошо. Плитка в горячем коридоре — охлаждение пола вместо серверов.

Расчёт кондиционера для серверной: формула и нюансы

Зная тепловую нагрузку, можно подобрать холодильную мощность кондиционера. Формула расчёта кондиционера для серверной привязана к двум параметрам: тепловыделение (Q) и коэффициент энергетической эффективности (COP) выбранной системы.

Q_cooling = Q_total / COP × запас

COP (Coefficient of Performance) показывает, сколько кВт тепла отводит система на каждый потреблённый кВт электроэнергии. У прецизионных кондиционеров COP обычно в диапазоне 2.5–4.0, у чиллерных систем — 3.0–5.0, у фрикулинга зимой COP может достигать 10–20 (тепло отводится «бесплатно» наружным воздухом).

Для серверной с тепловой нагрузкой 40 кВт:

| Система охлаждения | COP | Потребление охлаждения (кВт) |

|---|---|---|

| Прецизионный кондиционер (фреон) | 3.0 | ~13.3 |

| Чиллер + фанкойлы | 4.0 | ~10.0 |

| Фрикулинг (при +5°C снаружи) | 12.0 | ~3.3 |

Резервирование — отдельная тема. Схема N+1 означает, что при выходе из строя любого одного кондиционера оставшиеся справляются с полной нагрузкой. Для серверной на 40 кВт с двумя прецизионными кондиционерами по 40 кВт каждый — один работает, второй в резерве. Или три по 20 кВт, где два работают и один резервный. Второй вариант гибче, но дороже в обвязке.

Влажность тоже входит в расчёт. Прецизионные кондиционеры (в отличие от бытовых сплит-систем) контролируют и температуру, и влажность. Бытовой кондиционер в серверной — инженерный позор: он сушит воздух до 15–20% RH, не имеет резервирования и отключается при минусовых температурах снаружи.

Воздушные потоки: front-to-back и что бывает, когда всё не так

Серверное оборудование проектируется с воздушным потоком front-to-back: холодный воздух входит спереди, проходит через радиаторы CPU и GPU, нагревается и выбрасывается сзади. Это стандарт для 99% rack-mount серверов. Сетевое оборудование — сложнее: коммутаторы бывают как front-to-back, так и side-to-side, а некоторые модели Cisco и Arista — back-to-front. Перед установкой всегда проверяйте направление потока в документации.

Скорость потока через стойку зависит от мощности: стойка на 5 кВт прокачивает через себя примерно 800–1000 м³/ч воздуха, стойка на 20 кВт — уже 3000–4000 м³/ч. Серверные кулеры регулируют обороты вентиляторов по множеству параметров: температура CPU, температура на выходе, влажность, давление перед теплообменником. Радиаторы используют медные тепловые трубки и алюминиевые рёбра для передачи тепла от процессора в воздушный поток.

Когда направления потоков в стойке не совпадают (часть оборудования дует «не туда»), возникает рециркуляция — горячий воздух засасывается обратно. Температура на входе в соседние серверы растёт, вентиляторы выходят на максимальные обороты, шум становится невыносимым, а энергопотребление растёт. Проблема усугубляется в стойках со смешанным оборудованием — например, когда коммутатор с обратным airflow стоит в одной стойке с серверами. Единственное решение: либо развернуть оборудование, либо изолировать «нестандартные» устройства в отдельную зону с собственным воздухоснабжением.

Энергоэффективность и PUE: цифры, которые видит бухгалтерия

PUE (Power Usage Effectiveness) — отношение общего энергопотребления ЦОД к энергопотреблению IT-оборудования. PUE = 2.0 означает, что на каждый ватт вычислений тратится ещё один ватт на охлаждение и инфраструктуру. PUE = 1.2 — на инфраструктуру уходит только 20% сверху.

По данным Uptime Institute за 2024 год, средний PUE в индустрии — 1.56. Google отчитывается о PUE 1.09 по всему флоту своих ЦОД. Новые дата-центры выходят на показатели 1.2–1.3, но старые площадки с PUE 1.8–2.0 тянут среднее значение вверх.

Охлаждение — главный потребитель «лишней» энергии. Системы кондиционирования съедают 30–40% от общего энергопотребления ЦОД. Каждый пункт PUE — это реальные деньги. Для серверной на 100 кВт IT-нагрузки разница между PUE 1.6 и PUE 1.3 — это 30 кВт экономии, или примерно 1.5–2 млн рублей в год (при цене электроэнергии ~7 руб/кВт·ч).

Что реально снижает PUE:

- Containment горячего/холодного коридора — с 1.8 до 1.5, если раньше потоки не разделялись.

- Фрикулинг — в московском климате позволяет отключать компрессоры 6–7 месяцев в году.

- Повышение уставки — подъём температуры подачи с 18°C до 24°C (в пределах рекомендаций ASHRAE) снижает затраты на охлаждение на 20–25%.

- Частотные приводы на вентиляторах CRAH — вместо постоянной скорости вентиляторы подстраиваются под реальную нагрузку.

Что дальше: жидкостное охлаждение и утилизация тепла

Плотность стоек растёт. Если традиционная стойка потребляла 5–10 кВт, то серверы для AI-задач в одной стойке дают 40–100 кВт и выше. Воздух физически не справляется с отводом такого количества тепла: перепад температур и объём прокачки упираются в предел. Жидкостное охлаждение (direct-to-chip и иммерсионное) решает эту проблему: вода отводит тепло в 25 раз эффективнее воздуха. Переход с воздушного на 75% жидкостного охлаждения снижает энергопотребление систем охлаждения на ~15%.

Утилизация тепла — ещё один тренд, который из экзотики превращается в практику. ЦОДы генерируют огромное количество тепла, и выбрасывать его в атмосферу — расточительство. Финские и шведские дата-центры уже подают избыточное тепло в городские теплосети. В России, с длинным отопительным сезоном, это направление перспективно вдвойне. Температура обратного воздуха из серверных стоек (35–45°C) достаточна для подогрева теплоносителя через тепловые насосы.

Мониторинг замыкает контур. BMS (Building Management System) и DCIM-системы собирают данные с сотен датчиков температуры, влажности, давления и расхода воздуха. Без мониторинга Вы управляете охлаждением вслепую — и узнаёте о проблеме только когда сервер уходит в thermal throttling или, хуже, аварийно отключается. С грамотно настроенной системой мониторинга — видите тепловую карту зала в реальном времени, получаете алерты при отклонениях и можете реагировать превентивно. Интеграция DCIM с системами охлаждения позволяет автоматически корректировать уставки кондиционеров при изменении нагрузки — AI-оптимизация потоков уже работает в крупных ЦОДах, снижая PUE на дополнительные 5–10%.

Охлаждение серверной — это не та область, где можно «сэкономить и потом доделать». Неправильный расчёт тепловой нагрузки, отсутствие containment, бытовой кондиционер вместо прецизионного — всё это работает ровно до первого жаркого лета или первой серьёзной нагрузки. Считайте TDP честно, разделяйте потоки, резервируйте охлаждение по N+1, и Ваша серверная переживёт любой аврал без тепловых сюрпризов.